「AIエージェントを導入して業務を自動化したいけれど、

勝手に変なメールを送ったりしないか心配」

「気づかないうちに運用コストが跳ね上がっていたらどうしよう」

AIによる自動化が進む中で、このような不安を抱えている方は多いのではないでしょうか。

AIエージェントは非常に便利ですが、人間に代わって行動できる分、「コスト管理」と「セキュリティ(暴走リスク)」という新たな課題も生み出します。

この記事では、AIエージェントを安全かつ適正コストで運用するために、どこに「承認の壁」を置くべきか、どのような情報を渡してはいけないのか、具体的なリスク管理のポイントを解説します。

コスト管理:複雑な処理ほど「トークン」を消費する

AIモデル(特にLLM:大規模言語モデル)の運用コストは、主に「トークン数(文字数やデータ量に相当)」で決まります。

AIエージェントに複雑な指示を出したり、過去の長いやり取りをすべて記憶させたりすると、処理のたびに膨大なトークンを消費し、コストが高騰する原因になります。

コストを抑えるためには、以下の視点が重要

タスクの細分化:

1つのプロンプトで全てをやらせようとせず、処理をステップごとに分割する。

コンテキストの整理:

AIに渡す参考情報は必要最小限に絞る。-> 具体的な回答を得るという点でも有効です。

モデルの使い分け:

簡単な処理には安価な軽量モデル、高度な判断が必要な場合のみ高性能モデルを使用する。

セキュリティ対策1:「勝手な行動」を防ぐ承認フロー

AIエージェントにおける最大のリスクは、AIが人間の意図しない行動(ハルシネーションや誤判断)を勝手に行ってしまうことです。

特に、金銭が絡む決済や、対外的な情報発信においては、AIに全権を委ねるべきではありません。

「最終承認」の壁をどこに置くか

AIの自律性を活かしつつリスクをコントロールするには、「Human-in-the-loop(人間が介在する仕組み)」を組み込むことが不可欠です。

具体的には、以下のようなアクションの手前に、必ず人間が「OK」ボタンを押すプロセス(承認の壁)を設置します。

- クレジットカード決済・発注処理: カートに入れるまではAI、購入ボタンは人間。

- SNSへの投稿・メール送信: 下書き作成まではAI、送信ボタンは人間。

- データベースの書き換え: 変更案の提示まではAI、反映は人間。

このように、外部への影響が不可逆なポイントで人間がチェックすることで、「AIが勝手にやった」という事故を防ぐことができます。

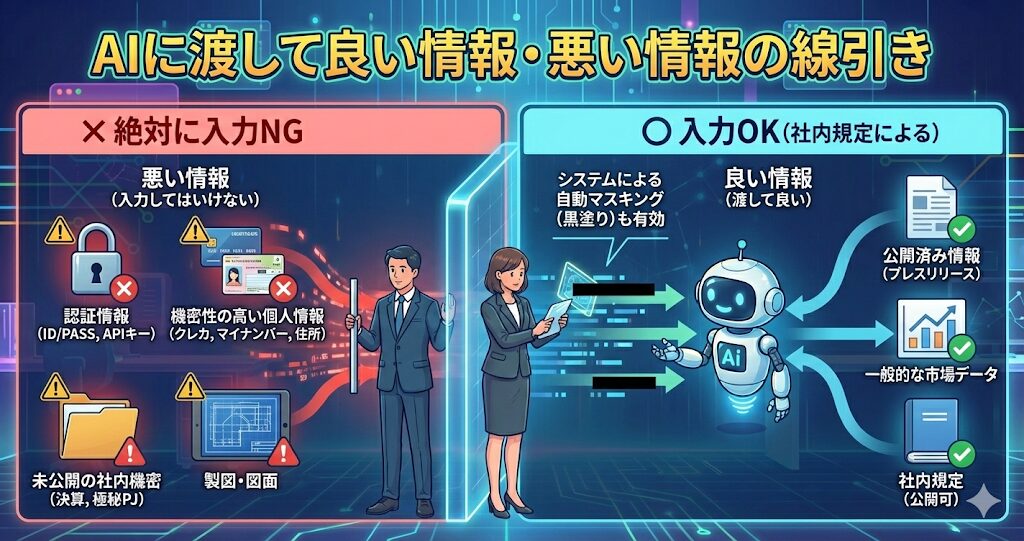

セキュリティ対策2:渡して良い情報・悪い情報の線引き

AIエージェントに社内データへのアクセス権を与える場合、「会社としてどの情報をAIに渡して良いか」の線引きを明確にする必要があります。

絶対に入力してはいけない情報

一般的に、以下の情報はAIのプロンプト(指示文)に直接含めるべきではありません。

認証情報:

ID、パスワード、APIキーなどのログイン情報。

機密性の高い個人情報:

顧客のクレジットカード番号、マイナンバー、住所など。

未公開の社内機密:

発表前の決算情報や極秘プロジェクトの詳細。ローカルのパソコンで作業している製図や図面。

社内のセキュリティ規定を確認し、AIに入力可能なデータ区分を定めておくことが重要です。また、システム側で個人情報を自動的にマスキング(黒塗り)する仕組みを導入するのも有効な対策の一つです。

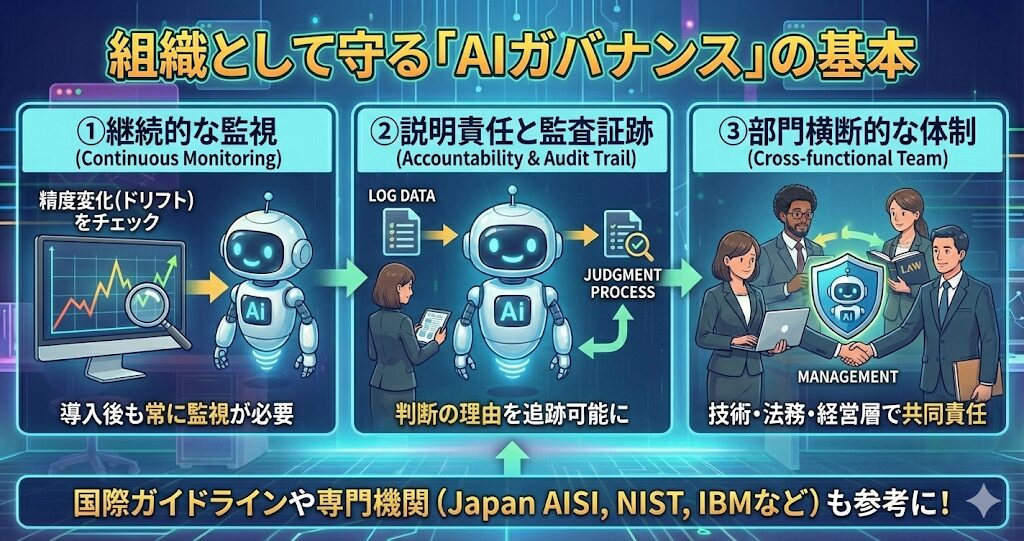

組織として守る「AIガバナンス」の基本

AIを安全に運用するためには、個人の注意だけでなく、組織全体でのルール作り(AIガバナンス)が求められます。国際的なガイドラインや専門機関の知見も参考にしましょう。

主な指針とベストプラクティス

権威ある機関(Japan AISI、NIST、IBMなど)が提唱するAIガバナンスの考え方には、以下のような共通点があります。

継続的な監視:

AIモデルは時間の経過とともに精度が変化(ドリフト)することがあるため、導入後も常に監視が必要です。

説明責任と監査証跡:

「なぜAIがその判断をしたのか」を後から追跡できるよう、意思決定プロセスのログを残すことが推奨されます。

部門横断的な体制:

技術部門だけでなく、法務や経営層を含めた「共同責任」の体制でリスクを管理します。

特にIBMなどの専門企業は、AIのリスクやバイアスを自動検知するダッシュボードの導入を推奨しており、組織の規模に応じてこうしたツールの活用も検討すると良いでしょう。

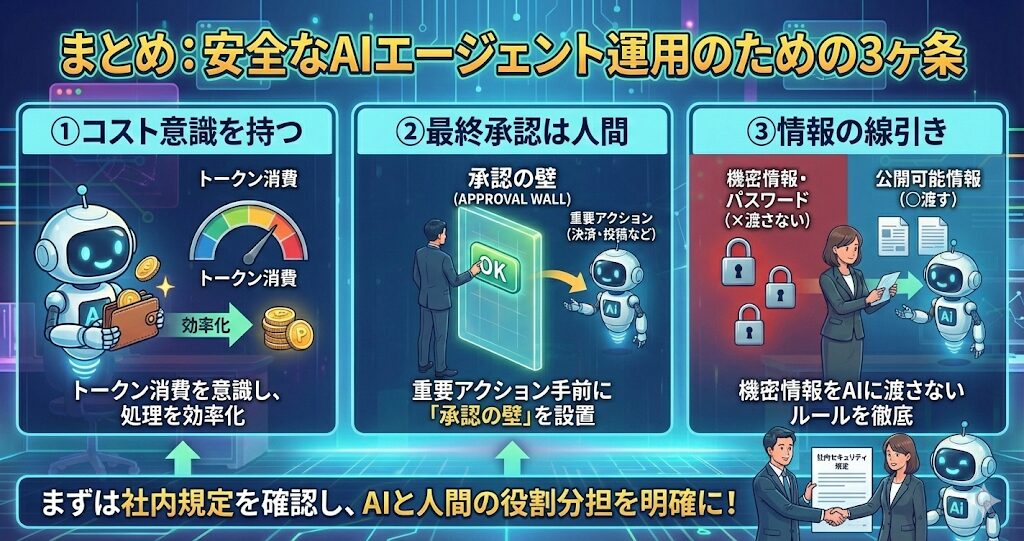

まとめ

AIエージェントは強力なツールですが、放置すればコスト増やセキュリティ事故のリスクとなります。安全に運用するためのポイントは以下の3点です。

- コスト意識を持つ: トークン消費を意識し、処理を効率化する。

- 最終承認は人間が行う: 決済や投稿などの重要アクション手前に「承認の壁」を設ける。

- 情報の線引きをする: 機密情報やパスワードをAIに渡さないルールを徹底する。

まずは社内のセキュリティ規定を確認し、AIに任せる範囲と人間が担う範囲を明確にすることから始めましょう。